Waarom Big Tech Ai zelden ‘de veilige’ keuze is

In het kort

Veel organisaties kiezen voor Big Tech Ai‑platforms vanwege schaal, snelheid en laten we eerlijk zijn, merkbekendheid. Maar deze platforms bieden zelden echte controle over data, acties en governance. Voor organisaties met gevoelige processen is technische afdwingbaarheid belangrijker dan naam, omvang of integraties.

Big Tech klinkt vertrouwd. Dat is het vaak niet.

Steeds meer organisaties gebruiken Ai‑platforms van grote technologiebedrijven. Begrijpelijk: ze zijn snel beschikbaar, goed geïntegreerd en afkomstig van namen die iedereen kent. Microsoft (Copilot), Google (Gemini), OpenAI (ChatGPT). Dat voelt veilig.

Maar wie verder kijkt dan functionaliteit en merk, ziet een ongemakkelijke realiteit: Big Tech Ai is gebouwd op schaal en snelheid, niet op controle en afdwingbaarheid.

Voor organisaties die werken met klantdata, financiële informatie of operationele processen vormt dat een reëel risico. Zeker nu Ai‑systemen niet alleen antwoorden geven, maar ook zelfstandig acties uitvoeren binnen bedrijfsprocessen.

Contractuele beloftes zijn geen technische controle

Veel Big Tech‑aanbieders beloven dat data:

- niet wordt gebruikt voor modeltraining;

- veilig wordt opgeslagen;

- compliant wordt verwerkt.

Maar deze garanties zijn juridisch, niet technisch afdwingbaar.

In de praktijk betekent dat:

- data verlaat vaak alsnog jouw omgeving;

- verwerking draait op infrastructuur buiten jouw directe controle;

- gedrag van modellen en systemen is niet onafhankelijk verifieerbaar.

Dat maakt audits, risicoanalyses en bestuurlijke verantwoording complex of zelfs onmogelijk.

Wat Big Tech Ai wél goed doet

Laten we eerlijk zijn: Big Tech Ai‑platforms zijn indrukwekkend.

- Ze schalen moeiteloos;

- ze bieden uitgebreide functionaliteit;

- en ze leveren contractuele garanties rond privacy en compliance.

En precies daar zit het probleem.

Het echte onderscheid: verlaat jouw data je eigen omgeving?

De belangrijkste vraag bij Ai‑platforms is niet:

“Is dit van Big Tech (en dus vertrouwd)?”

Maar:

“Verlaat mijn data mijn eigen omgeving?”

Zodra data jouw netwerk verlaat, ontstaat jurisdictierisico bijvoorbeeld via wetgeving zoals de US cloud act. De US cloud act kijkt niet naar waar data staat, maar naar wie de infrastructuur beheert. Daarmee verdwijnt technische afdwingbaarheid en blijft vooral contractuele belofte over.

Vanaf dat moment:

- verlies je directe controle;

- wordt onafhankelijk toezicht lastiger;

- verschuift de volledige verantwoordelijkheid naar jou als organisatie.

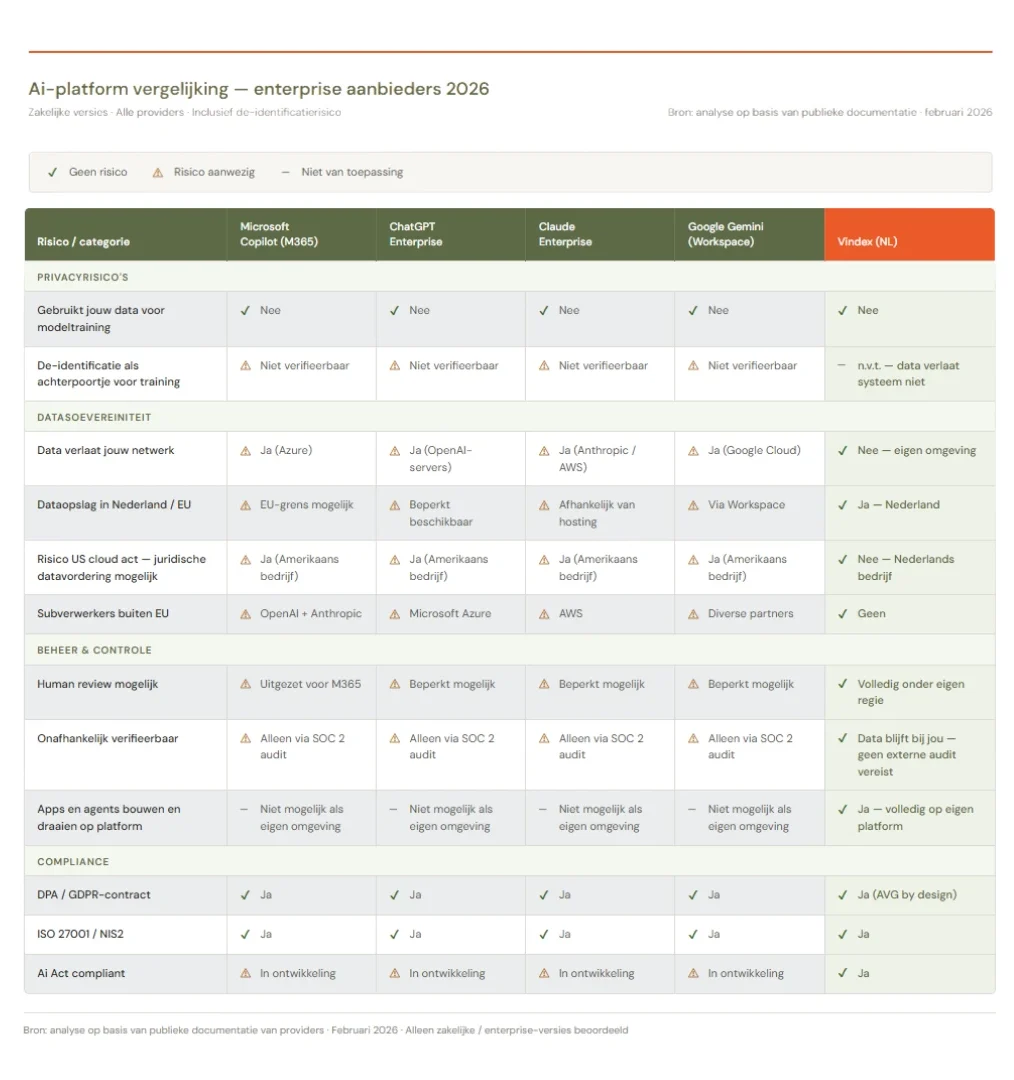

Vergelijking: Big Tech Ai‑platforms vs. gecontroleerde Ai‑architectuur

Onderstaande vergelijking laat zien hoe veelgebruikte Ai‑platforms omgaan met data‑locatie, controle en afdwingbaarheid en waar de fundamentele verschillen ontstaan zodra Ai onderdeel wordt van kernprocessen.

Veiligheid vraagt om architectuur, niet om merkbekendheid

Echte veiligheid ontstaat niet door schaal of merkbekendheid, maar door ontwerpkeuzes.

Een gecontroleerde Ai‑architectuur draait om:

- data die binnen je eigen omgeving blijft;

- transparantie over modellen en beslissingen;

- acties met duidelijke grenzen en autorisatie;

- volledige logging en herleidbaarheid;

- controle die technisch is ingericht, niet alleen contractueel.

Bovenstaande is geen extra, maar een randvoorwaarde zodra AI structureel meedraait in de operatie.

Conclusie

Big Tech Ai is krachtig, maar zelden de veilige keuze voor organisaties met gevoelige processen.

Niet het merk, maar de architectuur bepaalt of een Ai‑platform toekomstbestendig is.

Wie controle wil houden, moet verder kijken dan functionaliteit, prijs en integraties. Je moet begrijpen waar data zich bevindt, onder welke wetgeving deze valt en wie daadwerkelijk de regie heeft.

Jouw data. Jouw AI.

Jouw data. Jouw AI.